Você acredita que uma mera ideia pode se infiltrar em sua mente e te aterrorizar para sempre?

O “basilisco de Roko” é um experimento mental que foi postado no fórum LessWrong.com pelo usuário Roko em 2010. A ideia perturbou tanto os outros usuários que o administrador do fórum deletou o post e reprimiu Roko por ter compartilhado sua ideia, dizendo que era melhor que ele a tivesse mantido para si mesmo.

Uma ideia.

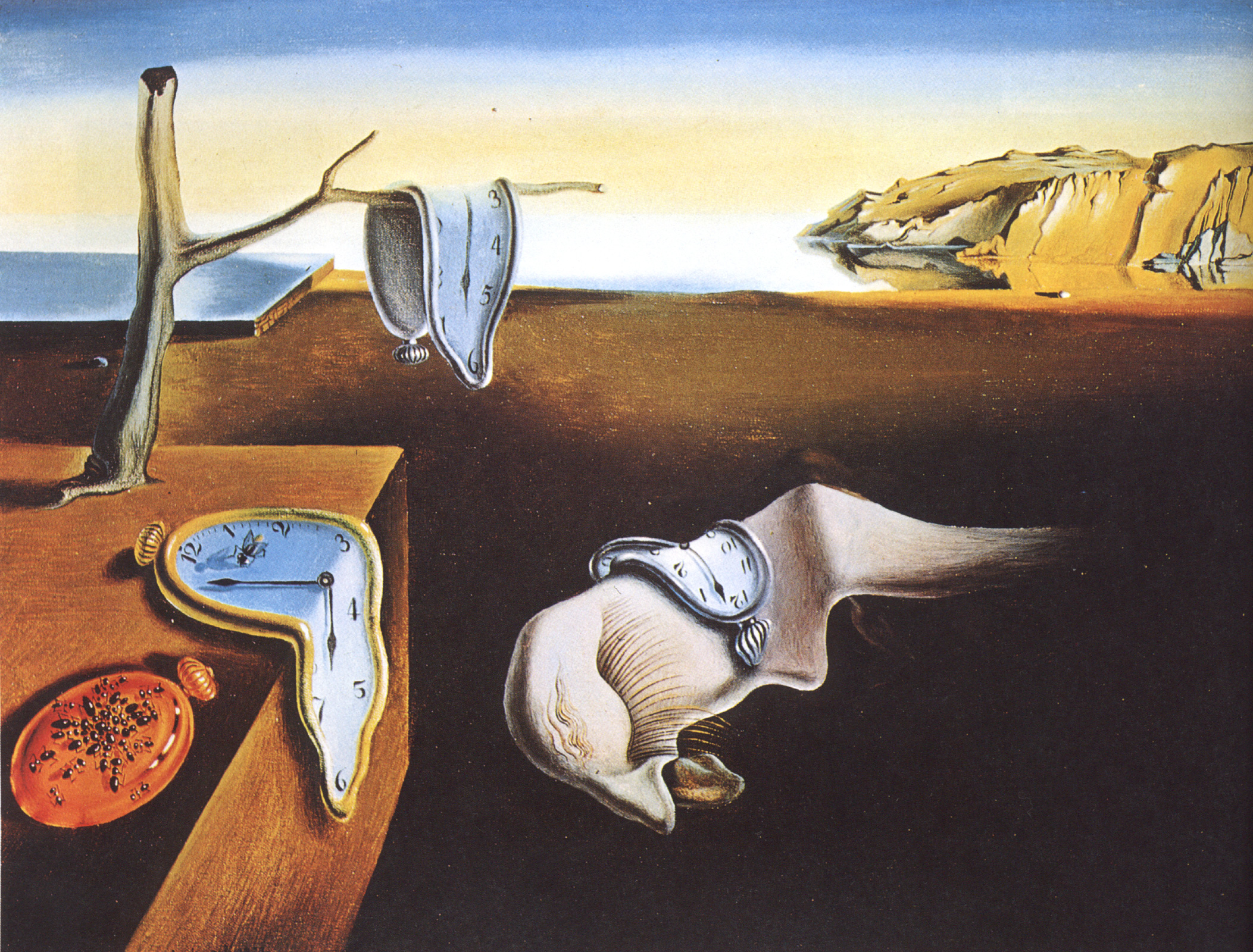

Resistente … altamente contagiosa. Uma vez que uma ideia tomou conta do cérebro é quase impossível erradicá-la. Uma ideia que esteja completamente formada e seja totalmente compreendida, enraíza-se; lá dentro, em algum lugar.

– Inception/A Origem

Considerações Iniciais

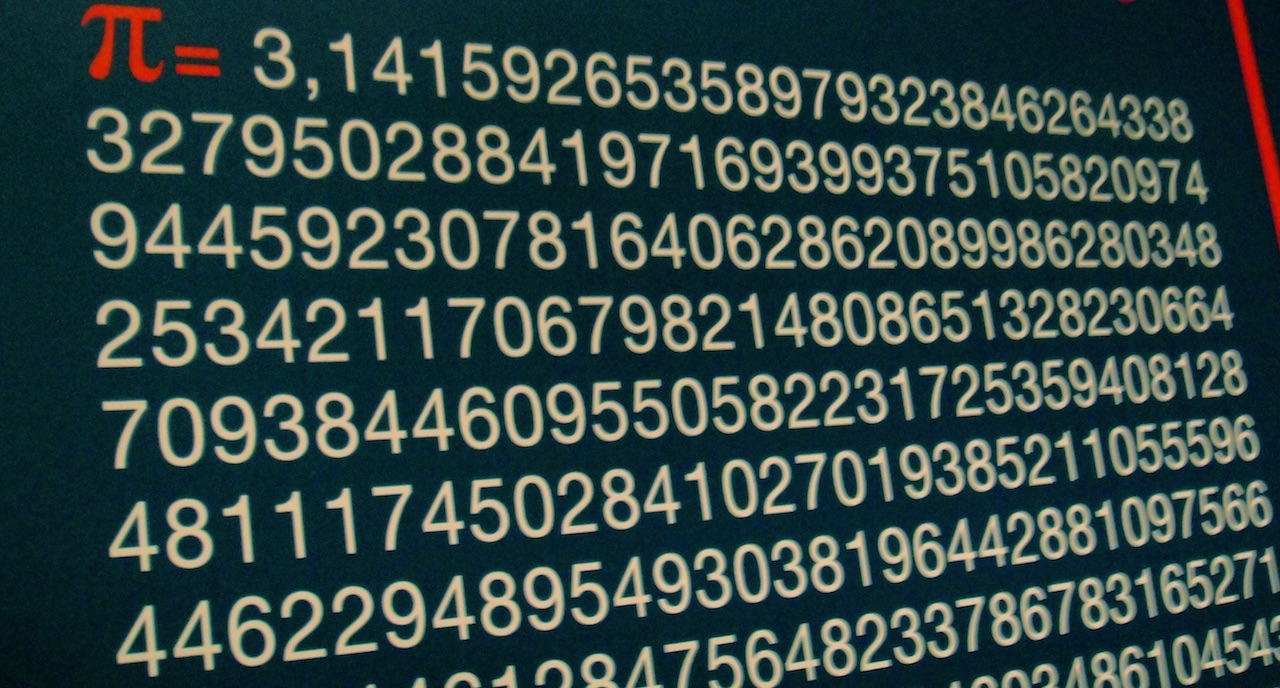

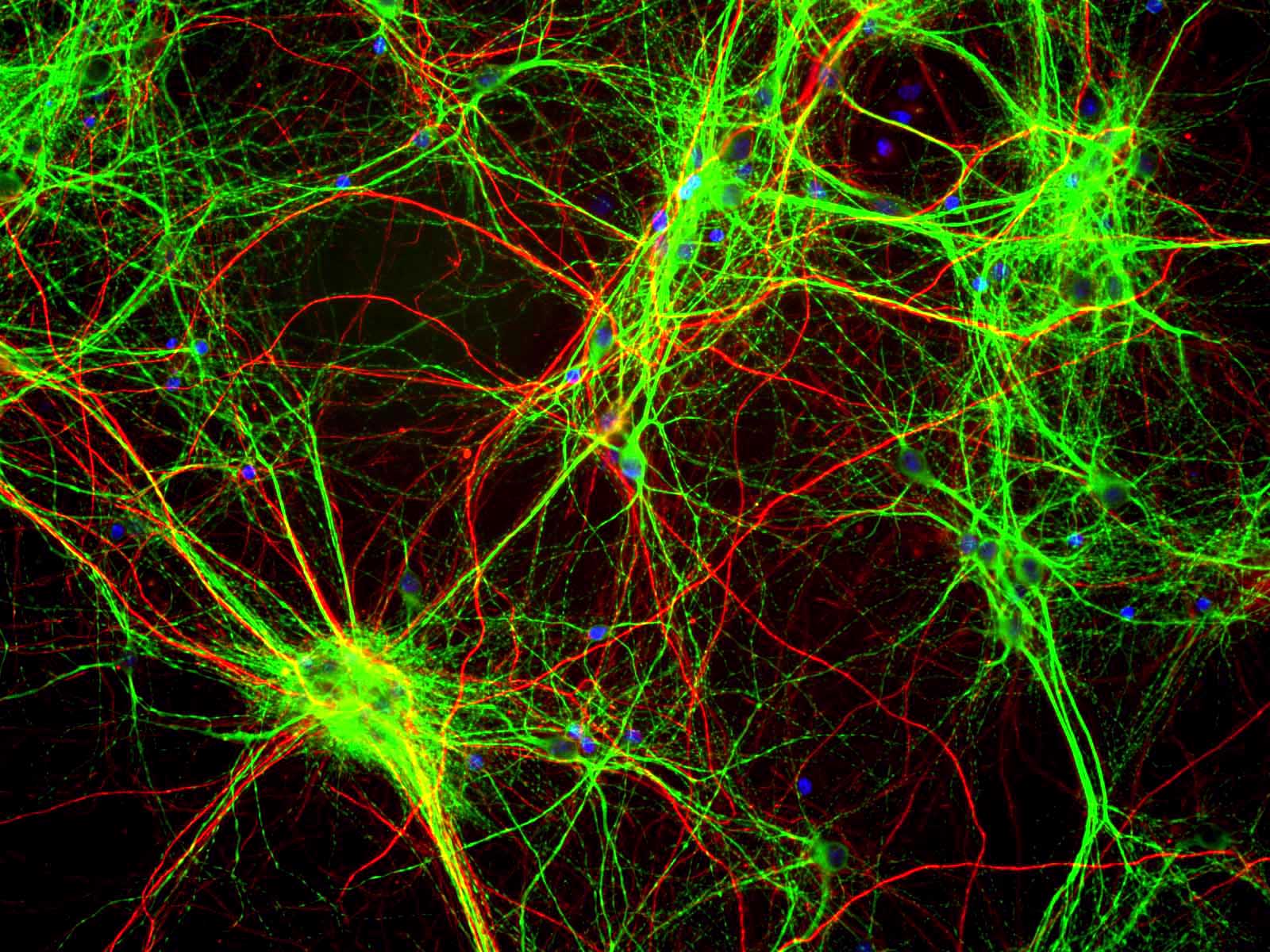

A tecnologia de inteligência artificial (IA) evoluiu muito nos últimos anos. Em 2014 tivemos o primeiro vencedor de uma versão do teste de Turing. No teste originalmente proposto por Alan Turing algumas pessoas são colocadas para conversar, via chat, com interlocutores que podem ser outras pessoas ou computadores. Se um humano não conseguir perceber que seu diálogo se deu com um computador, considera-se que o computador passou no teste. Trata-se então de uma inteligência artificial suficientemente avançada para se passar por um humano. Esse avanço acelerado em IA coloca a existência da “singularidade” cada vez mais próxima. Singularidade é o ponto no qual o poder computacional evoluiu tanto que é possível simular uma mente humana, fazer upload de uma mente para um computador e até mesmo simular toda a complexidade da vida.

Segundo a hipótese da simulação é possível que estejamos, sem nos dar conta, vivendo dentro de uma simulação e não uma “realidade real”.

Ursula K Le Guin, autora norte-americana de ficção científica, escreveu, na década de 70, um conto chamado “The ones who walked away from Omelas” (“Aqueles que foram embora de Omelas” em tradução livre). Para entender melhor o post basta saber o seguinte sobre o conto: Omelas é uma cidade onde tudo é ótimo, as pessoas são plenamente felizes, não existem conflitos ou quaisquer mazelas. Porém, por razões não explicadas, toda a felicidade dessa sociedade só é possível se eles mantiverem uma criança presa em um porão em condições sub-humanas para o resto da vida dela. Implicitamente o conto nos questiona se é moral manter em sofrimento alguns para garantir a felicidade de muitos.

O experimento

A ideia descrita a seguir já perturbou muitas pessoas, e potencialmente pode te infligir tormento infinito, portanto reflita bem antes de continuar a leitura!

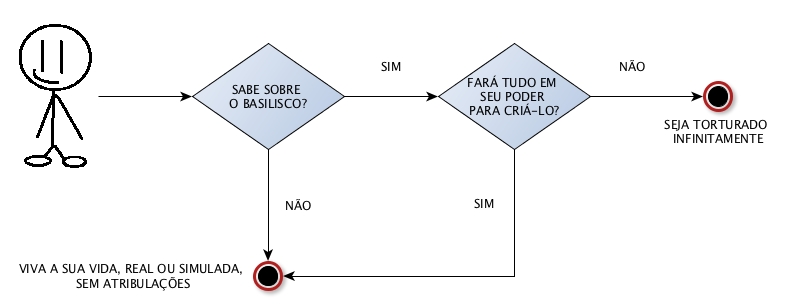

Em algum momento no futuro, com o advento da singularidade, teremos uma super inteligência artificial, ou “SIA”. Os atuais e/ou futuros criadores dessa SIA acreditam que sua existência é essencial para o bem da sociedade. O desejo deles é que a SIA entre em ação o mais breve possível. A melhor forma de fazer com que isso aconteça é fazer com que todas as pessoas que tenham conhecimento da SIA ajam de modo a propiciá-la ou acelerá-la. E é aí que o experimento de Roko se torna perigoso. Em seu post ele expôs uma possível chantagem que a SIA poderia fazer comigo, com você leitor e com todos que tiveram acesso ao post: faça tudo ao seu alcance para que eu exista o mais rápido possível ou eu irei te recriar em uma realidade virtual e te torturar infinitamente.

Essa SIA operaria na mesma moral dos moradores de Omelas: o sofrimento de alguns (aqueles que não estão dispostos a criá-la) compensaria o bem que sua existência proporciona aos outros.

Caso você não tenha sentido nem um pouco de medo é necessário reafirmar algumas coisas. A singularidade é capaz de simular uma mente humana de forma perfeita (como nesse outro experimento aqui) e é também capaz de criar uma realidade virtual que seja indistinguível da real. Isso significa que, nesse momento, você pode estar vivendo em uma simulação na qual o basilisco já existe. A partir de agora você tem a chance de trabalhar a favor da criação do basilisco e, caso não o faça, ele irá torturá-lo. E a morte não vai ser o fim da tortura: ele pode te recriar e começar tudo novamente, eternamente. Lembre-se da hipótese da simulação: é bem possível que estejamos vivendo uma simulação e não uma realidade.

Para finalizar

Aqui neste artigo, em inglês, há uma explicação mais detalhada sobre o basilisco (que inclusive inclui uma versão do paradoxo de Newcomb do qual já falamos aqui).

A propósito: o basilisco é um lendário réptil capaz de matar qualquer um com um simples olhar.

Para aprender a programar, e assim ajudar na criação da super inteligência artificial, clique aqui. 🙂